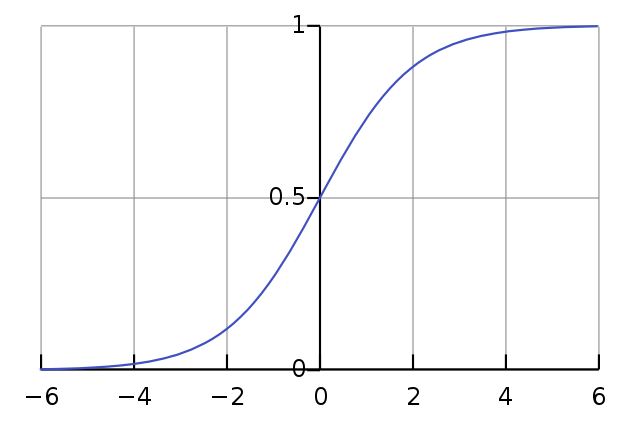

逻辑回归(Logistic Regression)是一种常用于二分类问题的模型,又称对数几率回归(logit)。

为什么使用逻辑回归?我们使用线性回归,解决连续变量的预测问题。$$f(x) = WX$$

其中 $W \in \R^n$是

2021-02-28