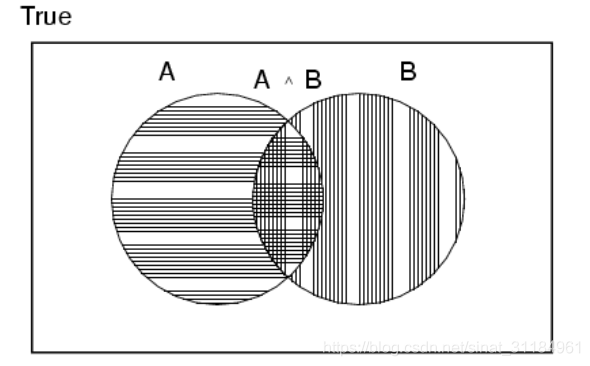

在概率论中, 对两个随机变量X和Y,其联合分布 (Joint probability distribution) 是同时对于X和Y的概率分布。事件A 和B 同时发生概率记为 $P(A, B)$。

离散随机变量的联合分布对离散随机变量而言

2021-02-24